Combattre les trolls algorithmiques

Je republie ici en intégralité une publication de Catherine Dorion qui met le doigt sur un problème majeur de notre époque: la haine automatisée en ligne.

Je vois plusieurs politiciens se désoler de "la haine en ligne" ou du mauvais climat sur les réseaux sociaux, et appeler tous leurs concitoyens à la gentillesse et à la paix. Je m'inquiète de constater l'infinie naïveté de ces appels, de constater que la discussion autour des bots et des faux comptes est presque au point mort dans notre conversation médiatico-politique.

Hier, j'ai fait une publication concernant ce "conflit dont il ne faut pas parler" sous peine de recevoir des torrents de haine numérique. J'ai cliqué sur chaque commentaire haineux (ils étaient très nombreux) pour voir de qui ils émanaient. J'estime qu'environ 90% émanaient de faux comptes ou de robots. Et combien du 10% restant avaient été en partie influencés par les 90% de robots ou de faux comptes?

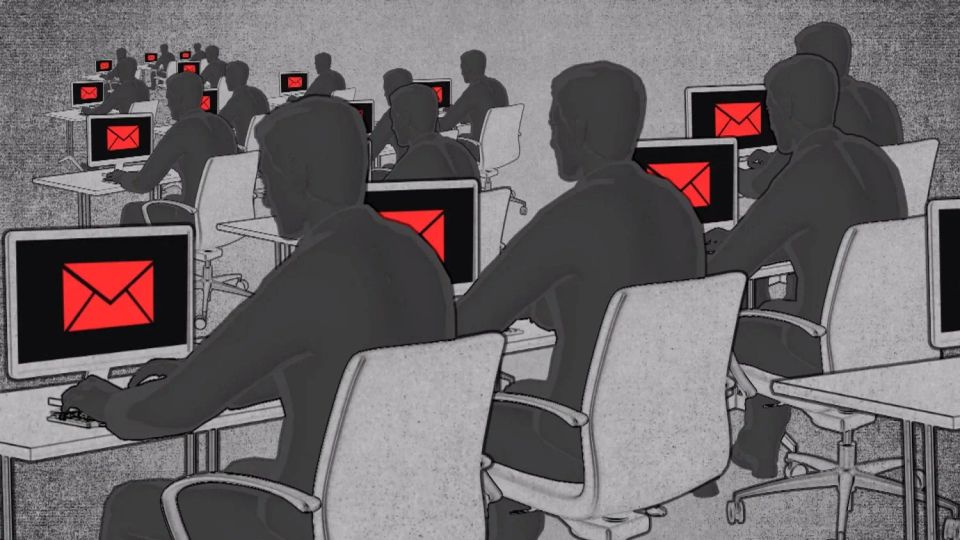

Noyer les réseaux sociaux dans la désinformation, de faux humains qui répandent des idées politiques chères à ceux qui ont les moyens de payer pour l'opération, voilà l'une des armes principales de l'extrême-droite dans le monde aujourd'hui. Ça commence à faire plusieurs années que des gens écrivent des livres fouillés là-dessus.

Certains avancent même qu'en frais de nombres de comptes, les vraies personnes seraient maintenant en minorité sur les principaux RS. Voilà pourquoi, quand vous vous attaquez à des gros intérêts (le pays dont il ne faut pas parler, l'industrie du pétrole, le président russe ou américain ou autre sujet politique) vous vous ramassez avec un torrent de haine en commentaire. Voilà pourquoi les moments électoraux sont toxiques comme ça sur les RS. Pas parce que les gens sont nombreux à être pas gentils. La politique est violente, et elle s'abat ainsi sur la conversation entre les citoyens ordinaires. C'est un trait typiquement totalitaire et ça devrait nous réveiller.

En gros, ces faux comptes-robots manipulent l'algorithme et créent des tendances virales qui n'en sont pas, intimident et découragent les citoyens qui ne pensent pas de la bonne façon, et stimulent la haine des autres. Ils s'entre-likent à l'infini. Une étude du gouvernement grec a montré que certains journalistes de haut niveau avaient un suivi lourd en bots—jusqu'à 40 % de leur audience présentait des caractéristiques de bots. On peut facilement imaginer ce qui se passe aussi avec les pages de politiciens. Ça concorde avec ce que j'ai vécu en tous cas. Cela soulève de sérieuses préoccupations quant à l'intégrité du discours en ligne et à la facilité avec laquelle les comptes automatisés peuvent influencer de vraies personnes qui auront à leur tour une véritable influence humaine sur les autres.

L'automatisation de faux comptes animés par l'intelligence artificielle et les fermes de trolls constituent maintenant une des armes principales de l'extrême-droite dans le monde. C'est une guerre de l'information qui se déroule devant nos yeux. Plusieurs personnes ont sonné l'alarme. Je prendrai peut-être le temps de vous faire une liste de livres ou de liens vidéos, mais il me répugne de plus en plus de le faire ici. (N'hésitez pas à en mettre en commentaire si vous voulez).

Dans tous les cas, penser que c'est ici, à partir de ce lieu-ci, où nous sommes surveillés, fichés et constamment soumis à des pressions psychologiques toxiques, qu'une conversation collective capable de réfléchir la résistance pourra émerger, c'est se crisser une estie de grossse poutre dans l'oeil. On ne répare pas une relation toxique. On la quitte pour vivre sa vie ailleurs. Pensons-y.

Ainsi, il est non seulement possible, mais très probable, qu'une bonne quantité de messages haineux qui se multiplient ces derniers temps ne soient pas le fruit de personnes fâchées, mais bien de faux comptes, de robots et de fermes à trolls visant à inonder les médias sociaux pour amplifier la polarisation des débats et les discours autoritaires de droite radicale.

Ça peut sembler un brin paranoïaque, mais ça ne l'est pas. Le phénomène est bien documenté depuis une dizaine d'années, où la présence de trolls russes et de fermes à clics ont produit des tonnes de messages sur Twitter et d'autres médias sociaux. Cela fait partie d'une "guerre cognitive" plus large visant à déstabiliser ses adversaires. Aujourd'hui, avec les grandes plateformes comme X et Meta qui ont décidé de retirer les mécanismes de modération de contenus, on laisse passer davantage de désinformation et de haine; le phénomène ne fait que s'amplifier.

Je le constate moi-même depuis quelque temps. Ma conjointe Maïka Sondarjee a reçu il y a quelques jours une vague de messages haineux et d'insultes. C'était arrivé dans le passé, mais pas avec un tel niveau d'intensité. De mon côté, j'ai publié un message de solidarité à propos du kidnapping de Nimâ Machouf sur Facebook il y a deux jours, et malgré une tonne d'appuis et quelques messages négatifs de personnes que je connais, il y a aussi eu une grosse vague de messages haineux et insultants de trolls sionistes et de droite radicale.

En allant voir le compte de ces personnes, il s'agissait pour la majorité de comptes avec 10 à 30 amis, avec un profil sommaire qui semblait faux ou préfabriqué. J'ai supprimé des dizaines de commentaires désobligeants, j'ai bloqué quelques comptes, et cela m'a pris un bon 20 minutes à faire du ménage dans le flot de commentaires sous ma publication: supprimer, vérifier, bloquer, supprimer, hésiter, supprimer, etc.

Bref, ça n'enlève rien à la question de la cyberviolence qui continue de s'intensifier, notamment pour les personnes à gauche de l'échiquier politique. D'un côté, cela peut être rassurant de savoir que cette vague de haine n'est pas forcément le fruit de vrais humains fâchés contre nous, mais de robots qui essaient de nous faire peur et nous déstabiliser. D'un autre côté, cela demeure préoccupant qu'il est maintenant plus difficile de distinguer le vrai du faux, de savoir qui croire.

La haine en ligne est de plus en plus automatisée. C'est la cyberintimidation boostée aux stéroïdes algorithmiques. Combattre le fascisme, ce sera donc au XXIe siècle non seulement combattre le fascisme des humains autoritaires, mais aussi les robots programmés par les fascistes.

Avons-nous besoin de quitter les médias sociaux en masse, bref devons-nous déserter pour de bon ? Devons-nous nous créer des groupes d'autodéfense en ligne, à la manière des Black Panthers de l'époque, mais en remplaçant les fusils par des commentaires et des clics? Devrons-nous nous aussi produire des robots socialistes, anti-autoritaires et anti-fascistes pour combattre l'autoritarisme qui déferle partout, notamment en ligne? Je ne sais pas encore sur quel pied danser, mais la guerre cognitive fait rage et nous devons changer nos tactiques et nos stratégies de résistance.

Member discussion